PageIndex:当RAG告别向量数据库,推理驱动如何重塑长文档检索

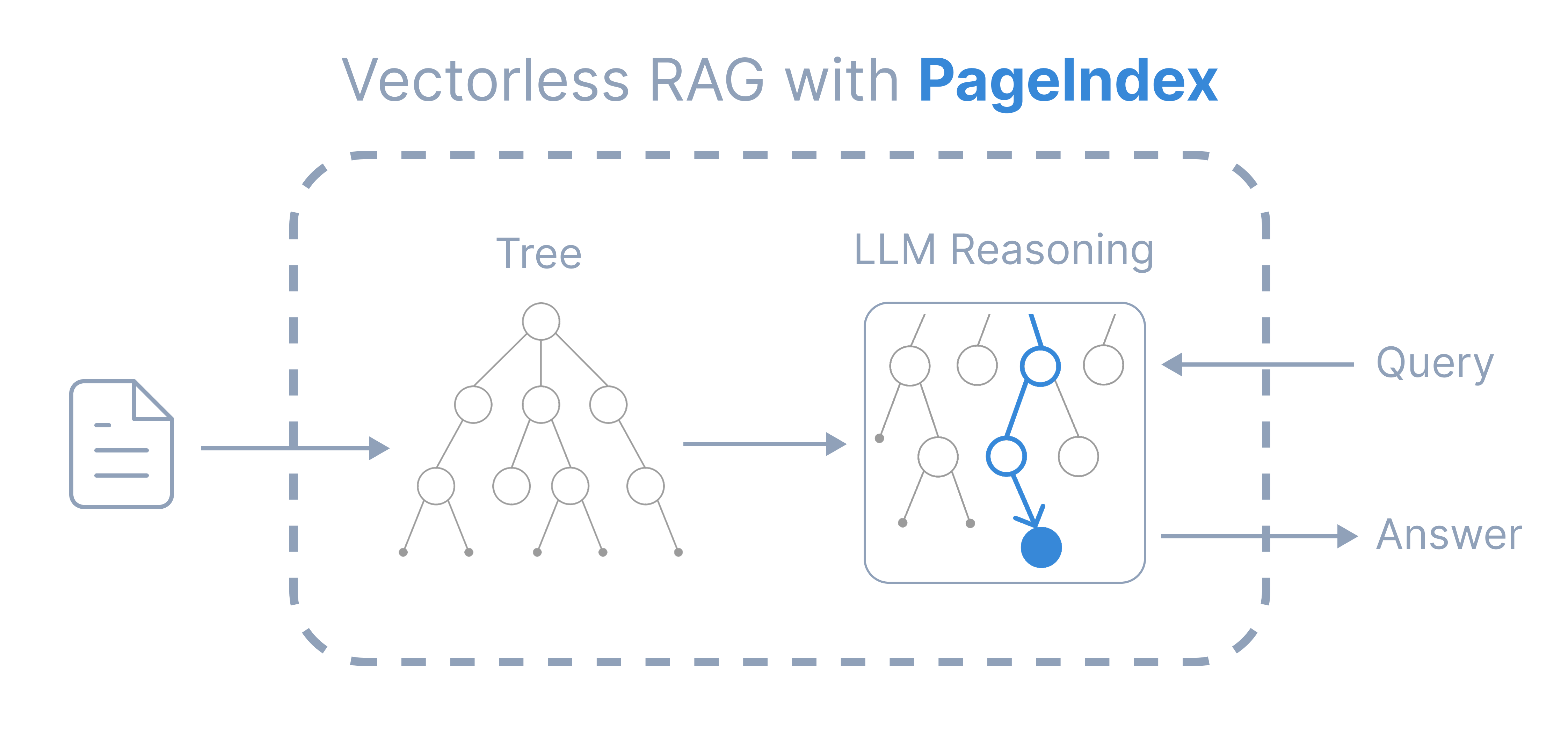

图片来源:PageIndex官方仓库

本文欲回答的核心问题:传统向量检索在处理专业长文档时为何频频失效?PageIndex如何通过”无向量、无分块”的推理驱动架构,实现真正的类人式精准检索?

在长文档智能分析领域,一个令人沮丧的现实是:传统RAG系统常常”答非所问”。当你向一个基于向量检索的金融分析系统提问”某公司第三季度无形资产减值的具体原因”时,它可能返回的是一段关于固定资产折旧的泛泛而谈。这种错位并非偶然,而是一个结构性缺陷的必然结果——语义相似性不等于真实相关性。

什么是PageIndex?

本段欲回答的核心问题:PageIndex究竟是什么?它为何被称为首个实现”类人检索”的RAG框架?

PageIndex是一个开源的推理驱动型检索增强生成系统,其核心理念大胆而直接:彻底抛弃向量数据库,拒绝机械式文本分块,让大语言模型像人类专家一样”思考”如何检索。它将冗长的PDF文档转化为层次化的树形索引结构,模拟人类阅读复杂文档时的导航逻辑——先扫视目录定位章节,再深入特定段落提取精确认知。

这个框架的特别之处在于,它并非在现有RAG pipeline上做增量优化,而是重构了检索的底层逻辑。传统RAG依赖向量相似度进行”模糊匹配”,而PageIndex通过生成”目录式”树结构索引,配合树搜索算法实现”精确推理”。这种设计使其在处理超过大模型上下文限制的专业文档时,表现出惊人的准确度与可解释性。

PageIndex目前已经演变为一个完整的产品生态:既有可本地部署的开源代码库,也提供开箱即用的Chat Platform云平台,同时支持MCP协议集成和API调用。这种灵活的部署选项意味着无论你是独立开发者还是企业用户,都能找到适合自己的接入方式。

作者反思:在我接触过的数十种RAG方案中,大多数都在向量维度和分块策略上打转,试图用更精细的调参弥补本质缺陷。PageIndex的思路让我意识到,我们或许一直在错误的方向上过度优化。人类专家从不把文档切成碎片再算相似度,而是通过结构化的目录和逻辑推理快速定位答案。这种”返璞归真”的设计哲学,恰恰是AI系统最缺乏的。

技术原理深度解析

本段欲回答的核心问题:PageIndex的”无向量、无分块”架构具体如何运作?其推理机制的技术本质是什么?

PageIndex的工作流程分为两个关键阶段,每个阶段都体现出对传统RAG的彻底背离。

树结构生成:从扁平文档到层次化知识地图

第一阶段,系统会将输入的长文档(PDF或Markdown)转化为一个语义树结构。这个树不是简单的目录提取,而是基于内容语义生成的”类目录”索引。每个节点包含四个核心属性:

-

title:节点所覆盖内容的语义化标题 -

node_id:唯一标识符,用于追踪检索路径 -

start_index/end_index:该节点对应的页码范围 -

summary:节点内容的精炼摘要 -

nodes:子节点数组,构成层级关系

实际生成的树结构如下所示:

{

"title": "Financial Stability",

"node_id": "0006",

"start_index": 21,

"end_index": 22,

"summary": "The Federal Reserve ...",

"nodes": [

{

"title": "Monitoring Financial Vulnerabilities",

"node_id": "0007",

"start_index": 22,

"end_index": 28,

"summary": "The Federal Reserve's monitoring ..."

},

{

"title": "Domestic and International Cooperation",

"node_id": "0008",

"start_index": 28,

"end_index": 31,

"summary": "In 2023, the Federal Reserve collaborated ..."

}

]

}

这种结构的价值在于,它保留了文档的原始逻辑层次。当处理一份200页的SEC财报时,系统不会将其切成20个10页的机械区块,而是可能生成”管理层讨论”、”财务报表”、”风险因素”等语义清晰的章节节点,每个章节下再细分具体议题。

应用场景示例:想象你正在分析一份法律合同。传统RAG可能把”违约责任”条款和”争议解决”条款混为一谈,因为它们语义相近。而PageIndex会构建”合同总则”、”权利义务”、”违约责任”、”争议解决”这样的树形结构。当你询问”违约金计算方式”时,系统会精准导航到”违约责任”节点,而非在多个相似段落间迷失。

推理式检索:AlphaGo式树搜索

第二阶段是检索的核心创新。系统不再计算向量相似度,而是让大语言模型在生成的树上进行”推理搜索”。这个过程类似于AlphaGo在围棋棋盘上做决策:模型会评估当前节点与问题的相关性,决定是深入子节点还是回溯到父节点,通过多步推理逐步缩小范围,最终定位到最相关的页面区间。

具体实现上,系统会维护一个搜索路径,每一步都由LLM基于以下因素做出决策:

-

当前节点摘要与查询的语义匹配度 -

子节点标题的指引性价值 -

已访问路径的上下文信息 -

剩余搜索预算(避免无限循环)

这种设计带来了两个突破性优势:

-

可解释性:检索路径完全透明。你可以清晰地看到系统为何选择第7章而非第3章,每个决策都有明确的推理依据,不再是不透明的”氛围检索”(vibe retrieval)。 -

精确性:由于搜索基于结构化推理而非模糊匹配,系统能够区分”看起来相似”和”真正相关”的内容。在金融分析中,这意味着能准确区分”收入确认政策”和”收入增长率”这两个截然不同的概念。

作者反思:传统RAG的”黑盒”特性一直是我的心头之痛。当系统返回错误答案时,你很难诊断是embedding模型的问题、分块策略的失误,还是向量检索的局限。PageIndex的透明路径让我想起了早期专家系统中的决策树——每个分支都是可审计的。在追求极致性能的同时保留可解释性,这种平衡在当下的AI开发中尤为珍贵。

核心特性与优势

本段欲回答的核心问题:相比传统向量RAG,PageIndex的具体改进点体现在哪些方面?

| 特性维度 | 传统向量RAG | PageIndex | 实际影响 |

|---|---|---|---|

| 检索基础 | 向量相似度搜索 | LLM推理驱动 | 从”模糊匹配”到”精准推理” |

| 文档处理 | 固定长度分块 | 保持原文结构 | 保留章节逻辑与上下文 |

| 知识表示 | 扁平向量空间 | 层次化树索引 | 模拟人类文档导航方式 |

| 可解释性 | 黑盒检索 | 完整推理路径 | 可追溯每个决策依据 |

| 扩展性 | 依赖向量数据库 | 无需额外存储 | 降低系统复杂度与成本 |

| 专业表现 | 在长尾查询中易失效 | 98.7%金融基准准确率 | 满足专业文档分析需求 |

无向量数据库的真实价值

去除向量数据库不仅仅是架构简化,更是认知范式的转变。向量数据库需要一个持续维护的索引构建流程:每当文档更新,你必须重新计算embedding、更新索引、处理版本兼容。在快速变化的业务环境中,这种开销常常被低估。

PageIndex的”零存储”设计意味着你可以直接对原始文档进行实时推理。对于法律咨询场景,当新法规文件发布时,无需等待索引重建,系统可以立即开始回答基于新文件的问题。这种即时性在专业领域往往比检索速度更重要。

无分块的自然优势

传统RAG的分块策略是一个永恒的痛点。块太大丢失精确性,块太小丢失上下文。PageIndex通过语义树节点完美解决了这个矛盾:父节点提供广度(章节概览),子节点提供深度(具体条款)。当你询问一个综合性问题如”描述公司面临的主要风险及应对措施”时,系统会自动在”风险因素”父节点下收集所有子节点的信息,生成全面回答。

应用场景示例:在医疗研究领域,一份临床试验报告包含”患者基线特征”、”干预方案”、”不良事件”、”统计学分析”等章节。传统RAG可能将”药物剂量”和”给药频率”切分到不同块中,导致回答不完整。PageIndex会保持”干预方案”章节的完整性,确保所有相关参数在同一节点内被检索和理解。

实战:从零开始部署PageIndex

本段欲回答的核心问题:开发者如何在实际项目中快速集成PageIndex?具体步骤和最佳实践是什么?

环境准备与依赖安装

部署PageIndex的门槛极低,核心依赖只有Python环境和大模型API密钥。整个过程不需要安装任何向量数据库或复杂中间件。

首先,克隆仓库并安装依赖:

# 克隆项目

git clone https://github.com/VectifyAI/PageIndex.git

cd PageIndex

# 安装依赖(仅需基础Python包)

pip3 install --upgrade -r requirements.txt

依赖列表非常精简,主要包括OpenAI的Python SDK和一些PDF处理库。这意味着你可以在15分钟内完成环境搭建,无需处理CUDA驱动或数据库配置等复杂问题。

接下来,配置API密钥。在项目根目录创建.env文件:

CHATGPT_API_KEY=sk-your-openai-api-key-here

作者反思:极简的依赖设计让我印象深刻。在过去实施RAG项目时,环境配置往往占据30%以上的时间成本,尤其是当团队成员使用不同操作系统时。PageIndex的这种”轻量级”哲学,让开发者可以专注业务逻辑而非基础设施,这对初创团队和资源有限的项目尤为友好。

核心代码实现

运行PageIndex只需一行命令,但理解其参数对获得最佳效果至关重要:

python3 run_pageindex.py --pdf_path /path/to/your/document.pdf

这条命令会触发完整的处理流程:PDF解析 → 树结构生成 → 索引持久化。处理完成后,你会得到一个JSON文件,其中包含可供后续查询的完整树索引。

让我们通过一个真实场景来理解这个过程。假设你正在分析特斯拉2024年Q3的SEC 10-Q文件(约150页),系统会生成类似这样的顶层结构:

{

"title": "FORM 10-Q Quarterly Report",

"node_id": "0001",

"start_index": 1,

"end_index": 150,

"summary": "Tesla, Inc. quarterly report for Q3 2024 covering financial results, risk factors, and management analysis",

"nodes": [

{

"title": "PART I - FINANCIAL INFORMATION",

"node_id": "0002",

"start_index": 2,

"end_index": 45,

"summary": "Condensed consolidated financial statements and notes"

},

{

"title": "PART II - OTHER INFORMATION",

"node_id": "0003",

"start_index": 46,

"end_index": 150,

"summary": "Risk factors, legal proceedings, and management discussion"

}

]

}

这种结构立即揭示了文档的宏观架构,使后续查询能够直接定位到”财务信息”或”其他信息”板块。

高级参数调优策略

对于追求极致效果的专业用户,PageIndex提供了一组精细的参数控制:

python3 run_pageindex.py \

--pdf_path /path/to/complex_report.pdf \

--model gpt-4o-2024-11-20 \

--toc-check-pages 30 \

--max-pages-per-node 5 \

--max-tokens-per-node 15000 \

--if-add-node-id yes \

--if-add-node-summary yes

参数调优的实际意义:

-

--toc-check-pages 30:对于没有明确目录的文档,增加检查页数可以帮助系统更好地识别章节边界。这在处理扫描版PDF时尤其有用。 -

--max-pages-per-node 5:将最大节点粒度从默认的10页降至5页,适合需要更精细检索的场景,如法律条款分析。代价是会增加token消耗和生成时间。 -

--max-tokens-per-node 15000:控制节点摘要长度,确保每个节点的summary足够精炼。对于技术手册类文档,建议增大此值以保留更多细节。

应用场景示例:在审计工作底稿分析中,审计师需要频繁跳跃查看”收入确认”、”成本核算”、”内部控制”等分散在不同章节的细节。将max-pages-per-node设为3-5页,可以确保每个审计要点都有独立的检索入口,避免在长篇大论中迷失关键信息。

Markdown支持的特殊考量

PageIndex不仅支持PDF,还能直接处理Markdown文件,这为开发者提供了极大的灵活性:

python3 run_pageindex.py --md_path /path/to/documentation.md

但这里有一个关键限制:Markdown处理依赖”#”符号的层级结构。如果文件是从PDF或HTML转换而来,且转换工具未能正确保留层次(大多数工具都存在这个问题),生成的树结构将是扁平且失真的。

最佳实践:对于技术文档,建议直接在源Markdown格式上运行PageIndex,而非经过二次转换的文件。如果你必须处理PDF,优先使用PageIndex OCR服务(虽然这部分在开源仓库中被注释,但文档提及了该功能),它能更好地保留文档的全局结构。

作者反思:这个功能设计暴露了PageIndex团队对真实世界的深刻理解。许多开发者会尝试”快速转换”PDF到Markdown,结果丢失结构信息。明确警告用户这一陷阱,并提供专门的OCR解决方案,体现了产品思维从技术导向转向用户价值导向——不为了功能列表好看而隐瞒局限。

应用场景与真实案例

本段欲回答的核心问题:PageIndex在哪些业务场景中能发挥最大价值?真实部署效果如何?

金融文档分析:Mafin 2.5的标杆实践

PageIndex最引人注目的成功案例是Mafin 2.5金融问答系统。该系统在FinanceBench基准测试上取得了98.7%的准确率,这是一个包含复杂财务问题的专业数据集,传统向量RAG在此类任务中通常只能达到70-80%的水平。

具体而言,Mafin 2.5处理的是SEC文件、财报电话会议记录、投资者演示文稿等非结构化长文档。例如,当被问及”亚马逊2023年Q4的资本支出中有多少用于AWS基础设施”时,系统需要:

-

在400页的10-K文件中定位”Consolidated Statements of Cash Flows” -

找到”Purchases of property and equipment”明细 -

交叉验证AWS部门的资本支出披露 -

计算比例并给出带引用的答案

传统RAG可能找到”资本支出”相关段落,但无法精确关联到AWS细分数据。PageIndex的树结构使系统能够先锁定”财务报表”父节点,再深入”现金流量表”子节点,最后精确定位到”分部门资本支出”的具体页码。

实际影响:对于金融机构的分析师,这意味着从”关键词搜索+手动翻页”的数小时工作,缩减到”自然语言提问+秒级精准定位”。更重要的是,系统返回的答案附带完整的推理路径,审计师可以追溯每个数字的来源页面,满足合规要求。

其他高价值场景

法律合同审查:在并购尽职调查中,律师需要快速定位”陈述与保证”、”赔偿条款”、”终止条件”等关键章节。PageIndex的树结构天然契合法律文书的章节体系,检索精度可达页级别,大幅降低漏检风险。

学术文献综述:研究者面对上百篇相关论文时,可以先用PageIndex构建每篇论文的”问题-方法-结果-结论”树,然后在整个文献库中进行”树对树”的推理式综述,而非简单的关键词匹配。

技术支持手册:对于复杂的设备维护手册,技术员提问”X型号发动机在低温环境下的启动故障排查”,系统能直接导航到”故障排除”→”启动问题”→”环境因素影响”节点,返回包含步骤、图示页码、安全警告的完整答案。

作者反思:向量搜索的局限与推理检索的未来

本段欲回答的核心问题:从技术实践角度看,PageIndex揭示了RAG领域的哪些根本性转变?开发者应如何调整认知?

在深度使用PageIndex后,我越来越确信我们正处于RAG范式的转折点。过去五年,行业几乎将所有精力投入到优化向量搜索:更好的embedding模型、更高效的近似最近邻算法、更智能的重排序策略。但这些都是在”相似性≠相关性”这个错误前提下的局部优化。

PageIndex的价值不仅是提供了一个新工具,更是提出了一种新思维方式:检索本质上是推理问题,而非匹配问题。当我们向系统提问时,我们期望的是”思考后的答案”,而非”看起来像答案的文本片段”。

这种认知转变对开发者意味着三点实践建议:

-

停止过度优化分块策略:如果花费超过20%的时间调整chunk size和overlap,你可能需要重新考虑架构选择。 -

重视文档结构:在RAG系统中,文档的原始结构(目录、章节、段落)是比向量相似度更可靠的知识载体。 -

可解释性是核心竞争力:在专业领域,用户更关心”为什么给出这个答案”,而非”答案看起来多流畅”。

独特见解:PageIndex的另一层启示是”大模型即索引”。传统架构中,embedding模型和生成模型是分离的,这导致了语义鸿沟。PageIndex让同一个LLM既”读”文档又”理解”查询,这种端到端的统一可能是未来所有AI系统的设计方向——不是为了统一而统一,而是因为推理链条的完整性决定了系统智能的上限。

实用摘要与操作清单

本段欲回答的核心问题:如何快速将PageIndex应用到实际工作流中?关键步骤和注意事项有哪些?**

部署清单

-

环境要求:Python 3.8+,OpenAI API密钥(或其他兼容LLM) -

安装命令: pip3 install -r requirements.txt -

快速测试:使用仓库中的样例PDF验证安装 -

生产准备: -

评估文档复杂度,设置 max-pages-per-node -

对扫描版PDF,考虑使用OCR预处理 -

实现结果缓存机制,避免重复生成树结构

-

使用最佳实践

-

对于结构化文档(有清晰目录):使用默认参数即可,系统会自动识别章节边界 -

对于非结构化文档(扫描版、报告):增加 --toc-check-pages到30-50,手动检查生成的树结构合理性 -

对于超大文件(500+页):建议拆分为逻辑卷(如按年份、部门),分别生成树后再建立顶层索引 -

成本优化:树结构生成是主要token消耗环节,生成后可复用。频繁查询时,建议持久化树结构到JSON文件

故障排查

-

生成的树结构扁平:检查PDF是否为扫描版,尝试使用OCR工具预处理 -

检索结果不相关:降低 max-pages-per-node值,确保节点粒度足够细 -

处理速度慢:使用GPT-4-turbo替代GPT-4,或在 --model参数中指定更快的模型

一页速览

PageIndex核心要点:

-

定位:面向长文档的推理驱动型RAG框架,无需向量数据库 -

创新:树结构索引 + LLM树搜索,模拟人类专家阅读方式 -

优势:98.7%金融基准准确率,检索路径完全可解释 -

部署:支持本地部署、云平台、MCP协议、API调用 -

适用:金融报告、法律文件、技术手册、学术论文等专业文档 -

限制:对扫描版PDF效果依赖OCR质量,Markdown需原生层级结构 -

成本:主要消耗在树结构生成阶段,后续查询成本低

快速启动代码:

# 安装

pip3 install -r requirements.txt

# 配置

echo "CHATGPT_API_KEY=your_key" > .env

# 运行

python3 run_pageindex.py --pdf_path your_doc.pdf

# 开始推理式检索

常见问题解答

1. PageIndex与传统RAG相比,最大的性能差异是什么?

核心差异在于检索准确率。传统RAG依赖向量相似度,在专业长文档中准确率通常在70-80%。PageIndex通过推理驱动检索,在金融基准测试中达到98.7%。这种差距源于前者匹配”关键词”,后者理解”真实意图”。

2. 没有向量数据库,如何处理大规模文档库?

PageIndex不是在运行时对比所有文档,而是为每份文档预生成树结构。查询时,系统按顺序(或并行)在每棵树上做推理搜索。虽然单次查询成本略高,但省去了向量索引的构建和维护开销,整体系统更简洁。

3. 生成的树结构质量如何保证?可通过哪些方式优化?

质量主要取决于文档本身的结构清晰度和LLM的理解能力。优化方式包括:调整--toc-check-pages帮助识别章节边界、设置--max-pages-per-node控制粒度、使用更高质量的PDF(非扫描版)。对于关键应用,建议人工抽查生成的树结构合理性。

4. 是否支持除OpenAI之外的模型?如何配置?

代码库默认使用OpenAI GPT模型,但通过修改run_pageindex.py中的模型调用逻辑,可以集成任何支持结构化输出的LLM。关键在于模型需要理解层次化结构并生成格式化的JSON。

5. 处理超长篇文档(如1000页技术手册)时有什么建议?

建议按逻辑模块拆分(如卷、部、功能模块),分别生成树结构。然后在顶层建立一个”目录树”,指向各个子树。这样既能保持检索精度,又能控制单次处理的token消耗。

6. 在金融、法律等强合规场景,PageIndex如何满足审计要求?

PageIndex的每项检索结果都附带完整的节点访问路径和页码引用,形成审计轨迹。你可以精确追踪”答案来自第X页Y章节”,这比传统RAG的”相似度分数”更符合合规审计的需求。

7. 树结构生成后,如果原文档更新怎么办?

目前没有增量更新机制,文档变更需要重新生成整个树结构。建议将树结构版本化存储,与文档版本对应。对于频繁更新的文档,可以考虑定期自动重生成策略。

8. 使用PageIndex的主要成本构成是什么?如何估算?

主要成本是树结构生成阶段的LLM调用费用,与文档页数和节点粒度正相关。以100页文档为例,使用GPT-4o生成树结构约需5-10美元,但这是一次性投入。后续查询仅消耗树搜索的token,通常每次查询不到0.1美元。相比维护向量数据库的人力成本,总拥有成本往往更低。

图片来源:PageIndex官方文档

最终思考:PageIndex的出现提醒我们,AI系统的进化有时候不是堆叠更多复杂组件,而是回归问题本质。当整个行业在向量维度上越走越深时,它选择了一条看似”逆向”却更贴近人类认知的道路。对于正在构建文档智能系统的团队,我的建议是:先抛开所有关于embedding和向量搜索的预设,问自己一个问题——”人类专家会如何一步步找到这个答案?” 如果你的技术方案能忠实模拟这个过程,你就走在了正确的方向上。