重塑智能体边界:小米 MiMo 模型矩阵的技术架构与应用实战

在人工智能从单纯的“对话者”向“执行者”演进的关键节点,小米发布了全新的 MiMo 模型矩阵。本文将深入解析 Xiaomi MiMo-V2-Pro、MiMo-V2-Omni 与 MiMo-V2-TTS 三款核心模型的技术特性、架构创新及其在 Agent 场景中的实际落地表现,为开发者与技术决策者提供一份详尽的参考指南。

本文核心问题:「小米 MiMo 模型矩阵如何通过架构创新与多模态融合,解决智能体在感知、决策与执行层面的核心痛点,并降低全模态 Agent 的落地门槛?」

一、Xiaomi MiMo-V2-Pro:面向 Agent 时代的旗舰基座

本段核心问题:「作为旗舰模型,MiMo-V2-Pro 在参数规模与架构设计上做出了哪些突破,以支撑高强度的 Agent 工作流?」

Xiaomi MiMo-V2-Pro 是专为现实世界中高强度 Agent 工作场景打造的旗舰基座模型,它通过大规模参数扩展与混合注意力机制的创新,实现了从“回答问题”到“完成任务”的能力跃迁。

1. 架构突破:万亿参数与高效推理的平衡

MiMo-V2-Pro 的核心竞争力在于其强大的基座能力。模型总参数量突破 1T(万亿级别),激活参数达到 42B,相较于前代 MiMo-V2-Flash,其规模扩大了约 3 倍。

这一巨大的参数规模并未牺牲推理效率。模型沿用了创新的 Hybrid Attention(混合注意力)机制,并将混合比例从 5:1 提升至 7:1。这意味着在参数量大幅增长的同时,模型依然维持了较高的推理速度,能够有效支撑高并发的业务场景。此外,轻量级 MTP (Multi Token Prediction) 层的引入,进一步优化了生成速度,使得模型在处理长文本生成时更加流畅。

在上下文窗口方面,MiMo-V2-Pro 支持 1M(百万)超长上下文长度。这对于 Agent 场景至关重要,因为它意味着模型可以“记住”更长的任务历史、更复杂的代码库或更详尽的文档背景,从而在长程规划和多步推理中保持一致性。

2. 性能表现:对标国际顶尖梯队

在全球权威大模型综合智能排行榜 Artificial Analysis 上,MiMo-V2-Pro 位列全球第八,国内第二。这一排名不仅代表了基准测试的分数,更反映了模型在实际应用中的综合实力。

图片来源:小米 MiMo 开放平台

在 Coding Agent、通用 Agent 和 Tool Use 等关键能力维度上,MiMo-V2-Pro 与 Claude 4.5 Sonnet、GPT5.2、Gemini 3.0 Pro 处于同一梯队。这种表现得益于训练策略的转变——坚持以“实际体感”为导向进行优化,关注模型在真实应用场景中的落地表现,而非单纯追求榜单分数。

图片来源:小米 MiMo 开放平台

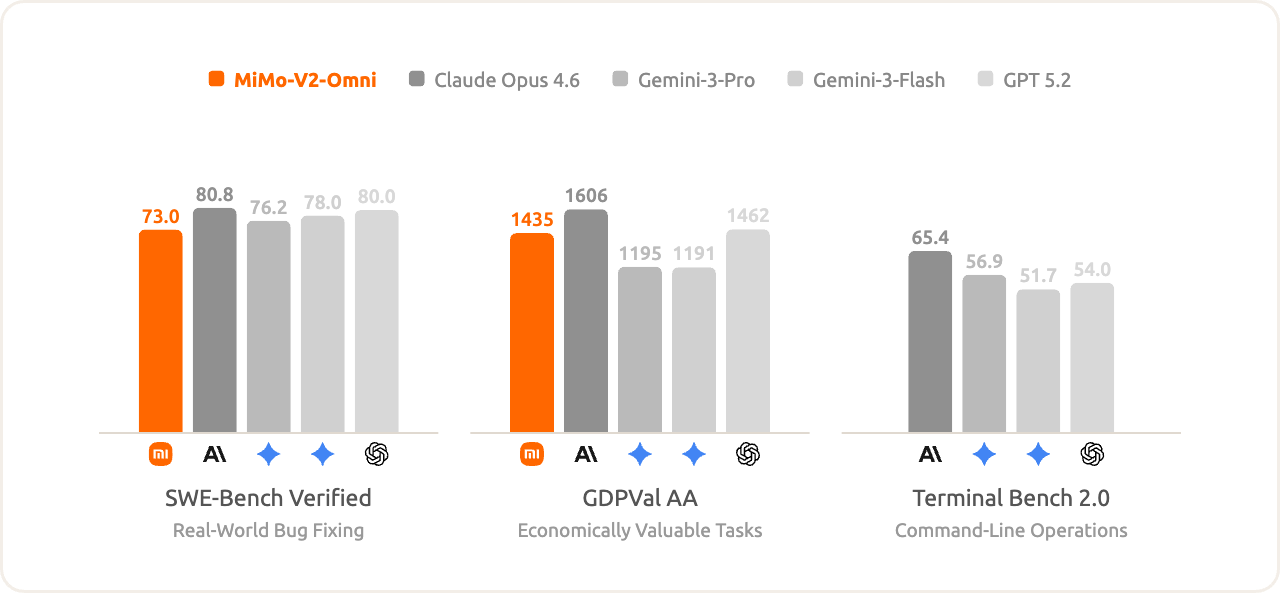

3. Agent 场景深度优化:从 OpenClaw 到代码工程

MiMo-V2-Pro 的发布并非仅仅为了展示算力,而是为了解决 Agent 落地中的实际问题。

OpenClaw 的原生大脑

OpenClaw 作为开源社区备受瞩目的通用智能体框架,对底层模型的能力提出了极高要求。MiMo-V2-Pro 针对复杂多样的 Agent Scaffold 进行了 SFT(监督微调)与 RL(强化学习),使其具备了更强的工具调用与多步推理能力。

在 OpenClaw 标准评测榜单 PinchBench、ClawEval 上,MiMo-V2-Pro 表现优异。其 1M 的超长上下文窗口,使其能够从容支撑高强度的真实 Claw 复杂应用流。下图展示了 Hunter Alpha(MiMo-V2-Pro 早期匿名版本)在评测中的表现,证明了其在复杂任务编排中的可靠性。

图片来源:小米 MiMo 开放平台

Coding 能力的进化

代码能力是衡量智能体逻辑严密性的试金石。MiMo-V2-Pro 已经超越了 Vibe Coding(氛围编程)的阶段,能够参与更严肃的代码工程构建。在小米内部工程师的深度评测中,其体感已接近 Claude Opus 4.6,展现出更出色的系统设计能力、任务规划能力以及优雅的代码风格。

值得注意的是,在 Hunter Alpha 测试阶段,调用量前几的应用多为编程专用工具。这直接印证了模型在真实研发场景下的高可用性——开发者真正在用它解决实际问题。

图片来源:小米 MiMo 开放平台

❝

「反思与见解」:

在大模型竞争白热化的今天,单纯堆砌参数已不足以构建护城河。MiMo-V2-Pro 的真正价值在于其架构效率与场景化训练策略。将“混合注意力机制”的比例从 5:1 提升至 7:1,显示了对推理成本的极致控制,这对于需要高频调用的 Agent 场景至关重要。更令我印象深刻的是其对“实际体感”的重视,这表明模型开发正在从“刷榜”回归到解决实际问题,这才是 Agent 时代最需要的底层逻辑。❞

图片来源:Unsplash

二、Xiaomi MiMo-V2-Omni:全模态 Agent 的感知与执行中枢

本段核心问题:「全模态模型如何打破“重理解、轻执行”的局限,实现从感知到行动的闭环?」

如果说 MiMo-V2-Pro 是 Agent 的大脑,那么 MiMo-V2-Omni 就是 Agent 的感官与手脚。这款模型专为现实世界中复杂的多模态交互与执行场景而生,从底层构建了融合文本、视觉、语音的全模态基座。

1. 感知能力:多模态信号的深度融合

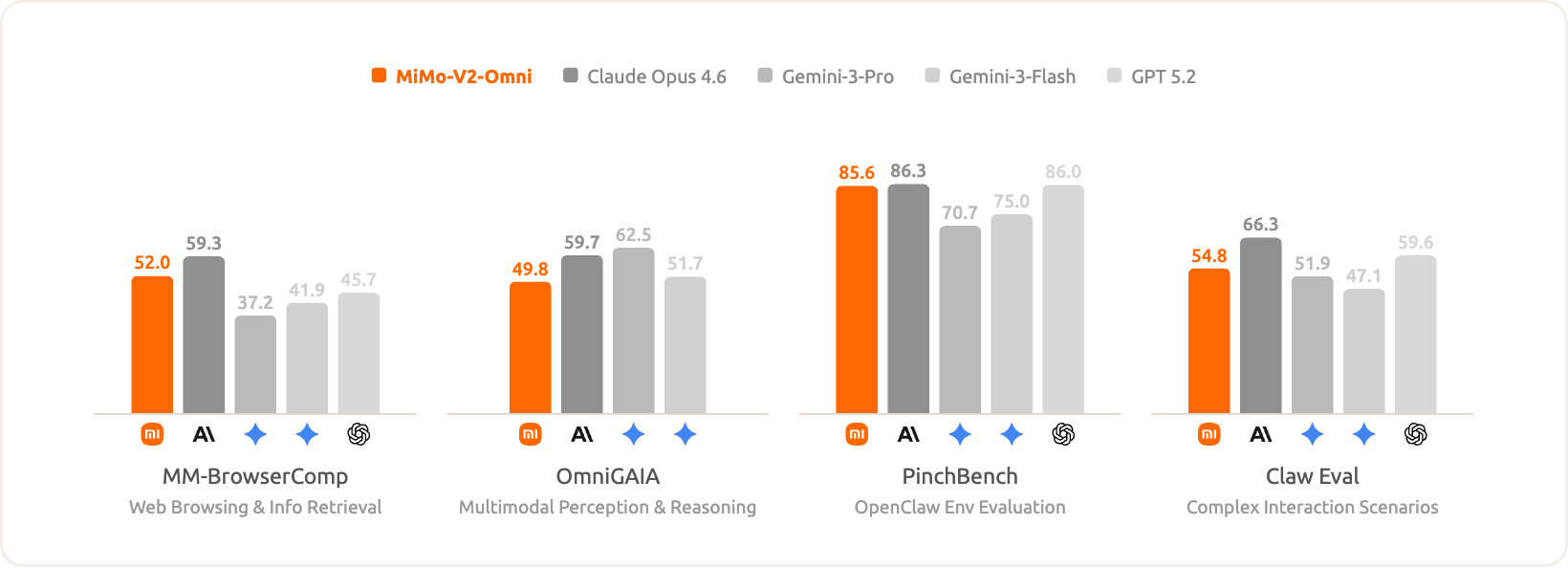

行动的前提是准确的感知。MiMo-V2-Omni 在感知层面实现了对图像、视频、音频的全面覆盖,并在多个维度对标国际前沿模型。

-

「视觉理解」:模型展现出强大的多学科视觉推理与复杂图表分析能力,超越 Claude Opus 4.6,逼近 Gemini 3 等顶尖闭源模型水平。这意味着它不仅能“看图说话”,还能理解复杂的逻辑图表和学术图像。 -

「音频理解」:支持从环境声分类、多说话人分离、音频-视觉联合推理,到超过 10 小时连续长音频的深度理解。综合表现超越 Gemini 3 Pro,是当前最强的音频理解基座模型之一。 -

「视频理解」:支持原生音视频联合输入,实现了真正的多模态视频理解。通过创新的视频预训练,模型具备了强大的情境感知与未来推理能力。

当多种模态同时输入时,统一架构的优势被进一步放大:跨模态信号相互增强,而非相互竞争。这种架构设计避免了传统多模态模型中常见的模态冲突问题,确保了信息的完整性。

2. 智能体能力:从理解到完成任务

感知是基础,行动是目标。真正的智能体模型,需要跨越多个模态观察复杂环境、制定计划并执行,甚至在出错时自主恢复,端到端地交付结果。

在与真实数字环境交互的评测基准上,MiMo-V2-Omni 表现优异,比肩 Gemini 3 Pro。其前沿的感知能力与原生训练的行动能力形成了复合优势:「感知越准确,行动越有效」。

图片来源:小米 MiMo 开放平台

同时,在纯文本智能体任务上,MiMo-V2-Omni 也保持了高度竞争力,证明了其在不同输入条件下的鲁棒性。

图片来源:小米 MiMo 开放平台

3. 实战场景解析:Browser Use 与智能办公

为了验证模型的实际应用价值,MiMo-V2-Omni 在极具挑战性的 Browser Use(浏览器使用)和智能办公场景中进行了测试。

Browser Use:真实世界的交互试金石

Browser Use 是衡量模型 Agentic 能力的最佳试金石。它要求模型在动态变化的网页环境中进行交互,处理异构的交互方式,甚至应对平台的反自动化检测。

-

「替你逛街砍价下单」:

在这个端到端购物任务中,模型展现了惊人的自主性。它首先操控浏览器在小红书浏览十余篇帖子,完成信息搜集与购买建议的整合;随后跨平台切换至京东进行多店比价;接着转接人工客服,使用自然语言进行砍价协商;最终完成加购下单。

整个过程中,模型自主应对了非标准的 DOM 结构、多页签上下文管理,以及在触发平台反自动化检测后的流程恢复。这不仅是简单的自动化脚本,而是具备了“策略”与“应变”能力的智能体雏形。 -

「TikTok 视频创作发布」:

在视频发布任务中,模型自主设计了四组画面并现场合成全部音效,实现了零外部素材依赖。在渲染过程中遇到中文字体报错时,模型能够自动修复并继续执行。随后,它操控浏览器打开 TikTok 上传页面,分析非标准输入控件完成文案填写,点击发布后继续进行点赞、评论,并回查确认审核通过与视频公开上线。

这一流程涵盖了“创意-制作-发布-运营”的全链路,充分展示了模型在内容创作领域的潜力。

智能办公:从草稿到准终稿

在办公场景中,MiMo-V2-Omni 能够通过自然对话直接生成高质量的 Word、结构化 Excel、排版规范的 PDF 与完整的 PPT。生成的文档不再是需要大幅修改的草稿,而是贴合实际需求的高质量“准终稿”。

-

「案例:2026高考志愿智能填报」

模型可以自主发起网络搜索获取原始信息,调用 skill 处理文件,并输出一份包含详细志愿建议和分级的 Excel 表格文件。这种能力将复杂的信息搜集与数据处理工作自动化,极大地提升了决策效率。

❝

「反思与见解」:

MiMo-V2-Omni 的发布标志着多模态模型正式从“展示型”转向“实用型”。最让我感兴趣的是它在 Browser Use 中的表现——处理非标准 DOM 结构和反自动化检测,这通常是需要人工干预的痛点。模型能在这里实现“端到端”,说明其鲁棒性已经达到了工业级应用的水准。这启发我们,未来的 AI 产品设计,或许不再需要为用户预留“修Bug”的入口,而是应该信任模型具备“自我修复”的能力。❞

图片来源:Pexels

三、Xiaomi MiMo-V2-TTS:能说会唱的语音合成大模型

本段核心问题:「如何通过自然语言实现对语音风格的高精度控制,使其逼近真人的表现力?」

在 Agent 与人交互的过程中,声音的温度决定了用户体验的上限。Xiaomi MiMo-V2-TTS 是小米自主研发的语音合成大模型,基于自研 Audio Tokenizer 和多码本语音-文本联合建模架构,实现了高度可控的多粒度语音风格控制。

1. 技术架构:大规模预训练与强化学习

MiMo-V2-TTS 经过了上亿小时语音数据的大规模预训练,并结合多维度强化学习。这种架构使其具备了极高的拟人度。它不仅支持从整体风格定调到局部情绪表达的精准调节,还能在同一句话内完成语气转折和情感递变,真实还原人类说话的自然韵律。在唱歌时,也能准确表达音高和节奏,自然且富有表现力。

2. 文本风格控制:自然语言驱动的精细调控

传统的 TTS 系统往往依赖于预设的标签,而 MiMo-V2-TTS 支持任意自然语言风格描述,打破了预设关键词的限制。

-

「灵活自定义控制」:

模型能理解并执行“撒娇 夹子音”、“慵懒 刚睡醒 有点沙哑”、“深情款款 语速慢”等自由组合短语。无论是情感控制(开心、悲伤、生气)、方言支持(东北话、粤语),还是角色扮演(孙悟空、林黛玉),模型都能精准响应。 -

「细粒度声音事件控制」:

为了增加真实感,模型支持在语音中自然插入笑声、咳嗽、停顿、思考犹豫、叹气等副语言声音事件。这些细节让生成的语音不再是机械的朗读,而是充满了生活的质感。

3. 深度文本理解:从格式信号到语音表达

MiMo-V2-TTS 具备深度文本理解能力,能智能识别文本中的格式信号并转化为对应的语音表达。

-

格式感知转化示例: -

全大写文本(如 “THIS IS IMPORTANT”)→ 自动加重语气强调; -

连续重复(如 “不不不不不”)→ 自动映射为对应的语音节奏和情感。

-

这一能力源于模型在预训练阶段学习的大量文本-语音对齐数据,使其能够自动将书面格式信号转化为自然的语音表达,无需开发者进行额外的标注工作。

4. 超越语音:方言、角色与歌声

MiMo-V2-TTS 的能力边界不断拓展,支持多种方言的自然发音、角色扮演式的风格化演绎,以及高质量的歌声合成。同一个模型既能说、能演,也能唱,为多模态 Agent 提供了极具表现力的“声音”接口。

❝

「反思与见解」:

语音合成领域长期存在“机械化”的痛点,即虽然字正腔圆,但缺乏情感张力。MiMo-V2-TTS 的突破在于引入了“细粒度声音事件控制”和“深度文本理解”。这让我意识到,未来的 TTS 技术不仅仅是“合成声音”,更是在“演绎文本”。通过识别全大写字母自动加重语气,这种看似微小的功能,实际上极大地降低了开发者的接入成本,无需复杂的 SSML 标记,仅凭文本本身就能传递情感。❞

四、API 服务与开发者接入指南

本段核心问题:「开发者在接入 MiMo 系列模型时,成本结构与接入方式是怎样的?」

为了方便全球开发者快速落地,小米 MiMo 开放平台提供了极具竞争力的 API 服务。

1. 定价策略与成本优势

MiMo 系列模型在保持高性能的同时,提供了极具性价比的定价方案,显著降低了前沿智能技术的使用门槛。

| 模型名称 | 上下文长度 | 输入价格 ($/百万 tokens) | 输出价格 ($/百万 tokens) | 备注 |

|---|---|---|---|---|

| 「MiMo-V2-Omni」 | 256K | $0.4 | $2 | 全模态感知与执行 |

| 「MiMo-V2-Pro」 | 256K 以内 | $1 | $3 | 旗舰基座模型 |

| 「MiMo-V2-Pro」 | 256K ~ 1M | $2 | $6 | 支持超长上下文 |

| 「MiMo-V2-TTS」 | – | – | – | 「限时免费」 |

表:MiMo 系列模型 API 定价一览

对比同级别的国际顶尖模型,MiMo-V2-Pro 的 API 定价仅为其 1/5 左右,这使得初创团队和企业能够以极低的成本进行技术验证与规模化部署。

2. 快速接入流程

开发者可以通过访问 Xiaomi MiMo API 开放平台 获取 API Key 并查看详细文档。平台支持标准的 API 调用格式,能够无缝集成至现有的智能体框架中。

五、实用摘要与操作清单

核心优势速览

-

「旗舰基座」:万亿参数与混合注意力架构,支持 1M 长上下文。 -

「全模态闭环」:视觉、听觉、语音与行动能力的深度融合。 -

「极致性价比」:旗舰模型价格仅为国际同类产品的 1/5,TTS 模型限时免费。

开发者操作清单

-

「场景选型」: -

若需处理复杂代码工程、长文档分析或多步逻辑推理,首选 「MiMo-V2-Pro」。 -

若需构建具备浏览器操控、多模态感知能力的 Agent,首选 「MiMo-V2-Omni」。 -

若需为应用注入富有情感的语音交互能力,接入 「MiMo-V2-TTS」。

-

-

「成本控制」:利用 MiMo-V2-Pro 的 256K 内低价区间处理常规任务,仅在必要时开启 1M 长上下文。 -

「体验优化」:在 TTS 场景中,充分利用自然语言风格描述(如“语速快、有点生气”),无需受限于预设标签。

六、常见问答 (FAQ)

「Q1:MiMo-V2-Pro 相比于前代模型,在架构上最大的改进是什么?」

A1:最大的改进在于参数规模扩大约 3 倍(总参数 1T,激活 42B),同时混合注意力机制比例提升至 7:1,实现了性能与效率的双重提升,并支持 1M 超长上下文。

「Q2:MiMo-V2-Omni 在 Browser Use 场景中如何应对网页结构的变化?」

A2:模型具备强大的感知与适应能力,能够自主应对非标准 DOM 结构和多页签上下文管理,甚至在遭遇平台反自动化检测时进行流程恢复。

「Q3:MiMo-V2-TTS 如何实现对语音风格的精细化控制?」

A3:它支持任意自然语言描述,开发者可以直接输入如“慵懒、刚睡醒”等短语,模型会自动理解并生成对应风格的语音,无需复杂的参数调节。

「Q4:MiMo 系列模型的 API 定价策略是怎样的?」

A4:MiMo-V2-Omni 输入价格低至 1/百万 tokens;MiMo-V2-TTS 目前限时免费。

「Q5:MiMo-V2-Omni 的音频理解能力具体包括哪些?」

A5:支持环境声分类、多说话人分离、音频-视觉联合推理,以及超过 10 小时的连续长音频深度理解,综合表现超越 Gemini 3 Pro。

「Q6:如何接入这些模型?」

A6:开发者可访问 Xiaomi MiMo 开放平台 获取 API 接口文档并进行接入。

「Q7:MiMo-V2-Pro 适合用于代码开发吗?」

A7:非常适合。在内部评测中,其体感接近 Claude Opus 4.6,具备系统设计、任务规划及优雅的代码生成能力,适合严肃的代码工程构建。

「Q8:MiMo-V2-TTS 除了说话还能做什么?」

A8:它还支持方言发音、角色扮演以及高质量的歌声合成,是一个全能型的音频生成模型。