DeepConf:让大语言模型推理更高效的新方法

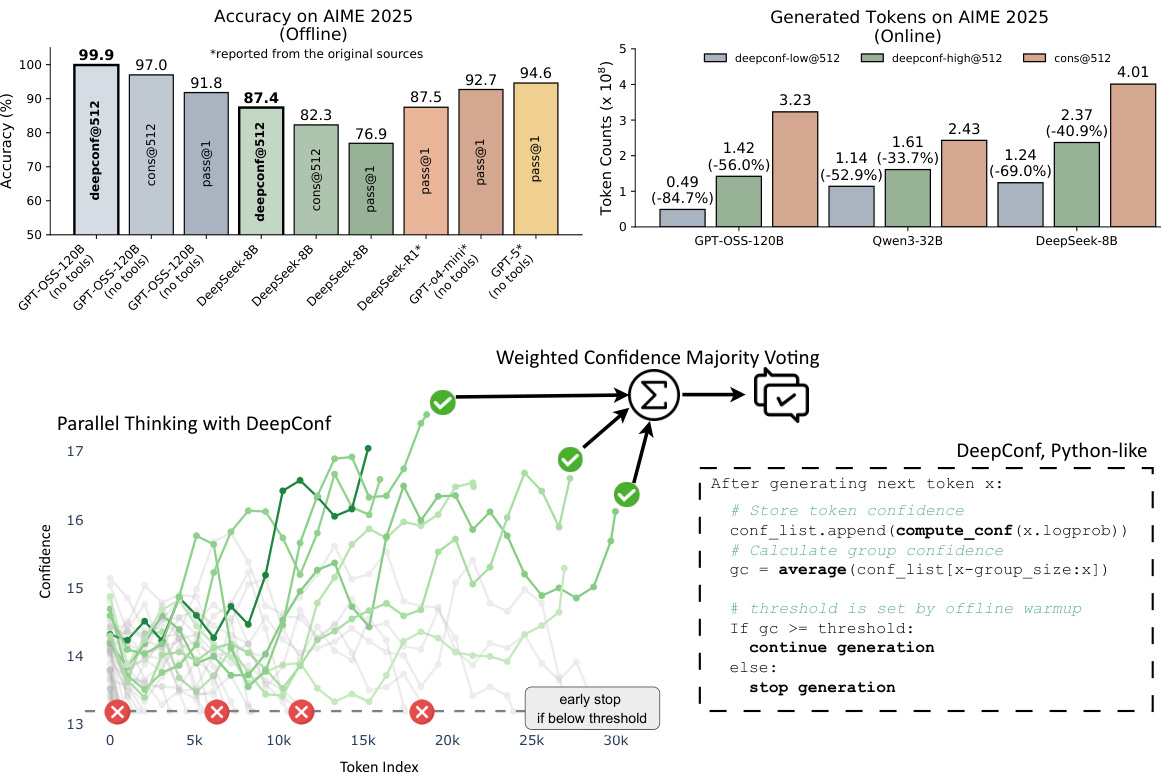

图1:DeepConf 在 AIME 2025 竞赛题目上的测试结果

一、背景:语言模型的”思考困境”

大语言模型(LLM)近年来在数学推理、代码生成等复杂任务上展现出惊人能力。但就像人类思考复杂问题需要反复推敲一样,模型也需要通过多次尝试来提高准确率。目前主流的”并行思考”方法(比如多数投票法)就像同时让多个学生解题然后取多数答案,虽然能提升准确率,但存在两个明显问题:

-

效率低下:生成每个推理路径都需要大量计算资源,题目难度越高需要的尝试次数越多。 -

质量参差不齐:多数投票法对所有答案一视同仁,就像让学渣和学霸的投票权重相同。

DeepConf 方法的出现,正是为了解决这两个痛点——通过分析模型”内心”的信心值,智能筛选出高质量的推理路径。

二、什么是”模型置信度”?

要理解 DeepConf 的工作原理,首先需要认识几个关键概念:

1. 令牌熵(Token Entropy)

想象模型在生成每个词语时,会为所有可能的词汇计算概率分布。熵值越高,说明模型对当前选择越不确定。比如在数学题中:

-

当模型写下”解”字时熵值较低(确定要开始解题) -

在关键公式推导时熵值较高(需要谨慎选择符号)

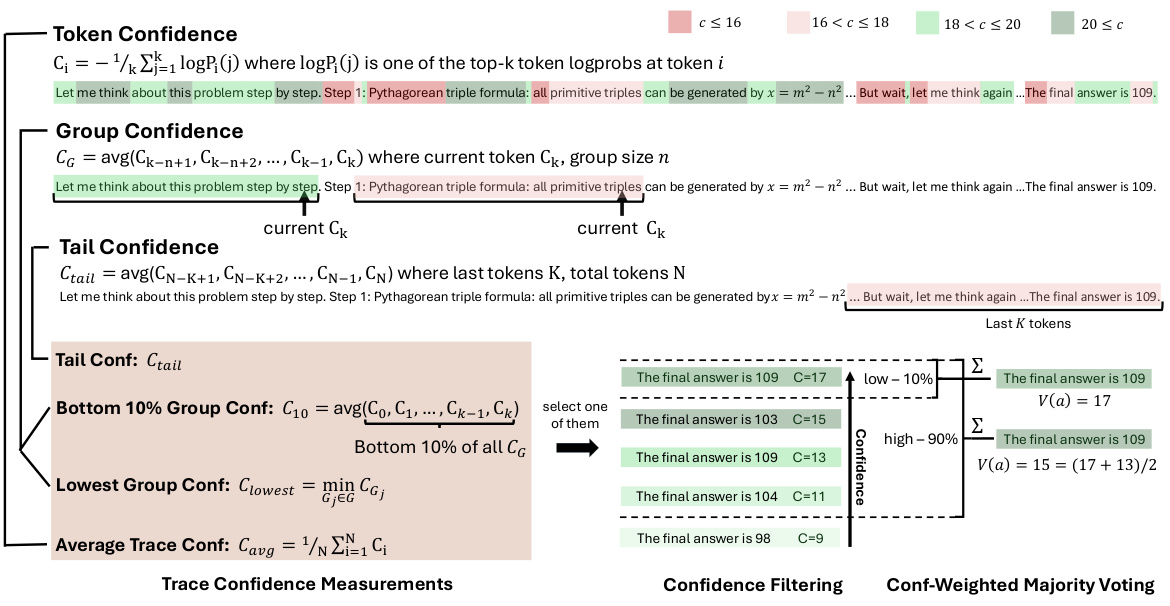

2. 令牌置信度(Token Confidence)

将前k个候选词汇的概率取对数后取负值,这个指标能更敏感地反映模型对当前输出的把握程度。

3. 轨迹置信度(Trace Confidence)

将整个推理过程中所有令牌的置信度进行加权平均,就像给学生的解题过程打分。

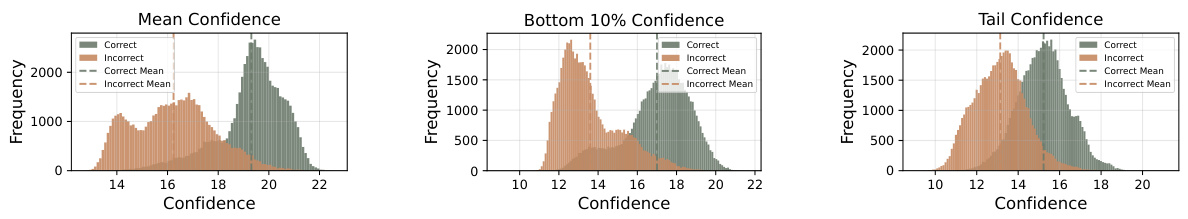

图2:正确(蓝色)与错误(红色)推理路径的置信度分布对比

三、DeepConf 的核心创新

1. 局部置信度测量

传统方法使用全局平均置信度,就像通过学期总评判断学生水平。而 DeepConf 提出更精细的测量方式:

| 测量方法 | 原理 | 适用场景 |

|---|---|---|

| 组置信度 | 滑动窗口统计连续令牌的置信度均值 | 捕捉推理过程中的信心波动 |

| 底部10%组置信度 | 关注最不自信的推理片段 | 识别关键错误环节 |

| 尾部置信度 | 重点考察最后2048个令牌的置信度 | 关注最终结论的可靠性 |

2. 离线优化方案

在已有完整推理路径的情况下:

-

置信度加权投票:给高置信度答案更高的投票权重 -

置信度过滤:只保留前10%或90%的高置信度答案参与投票

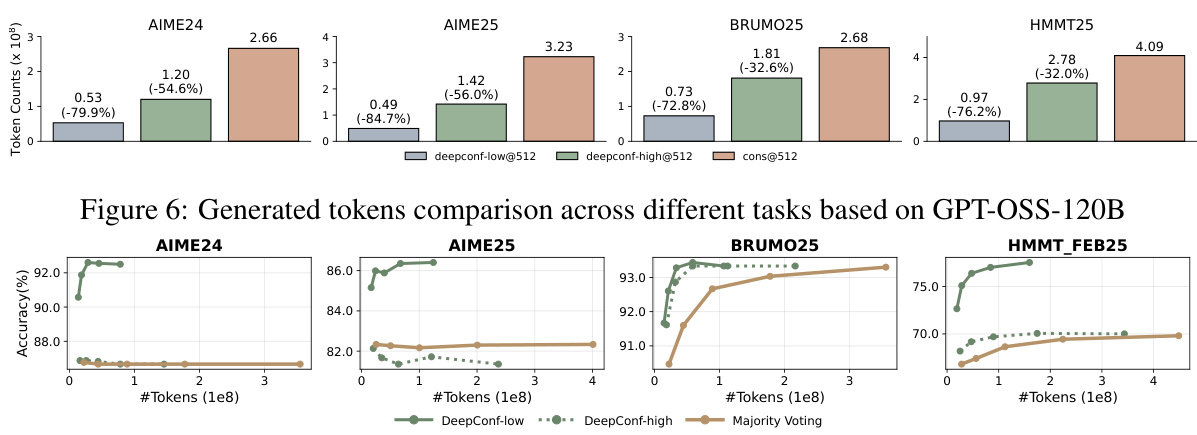

实验数据显示(表1),在AIME 2025竞赛题上:

-

GPT-OSS-120B模型通过保留前10%高置信度路径,准确率从97.0%提升至99.9% -

所需生成的令牌数减少84.7%

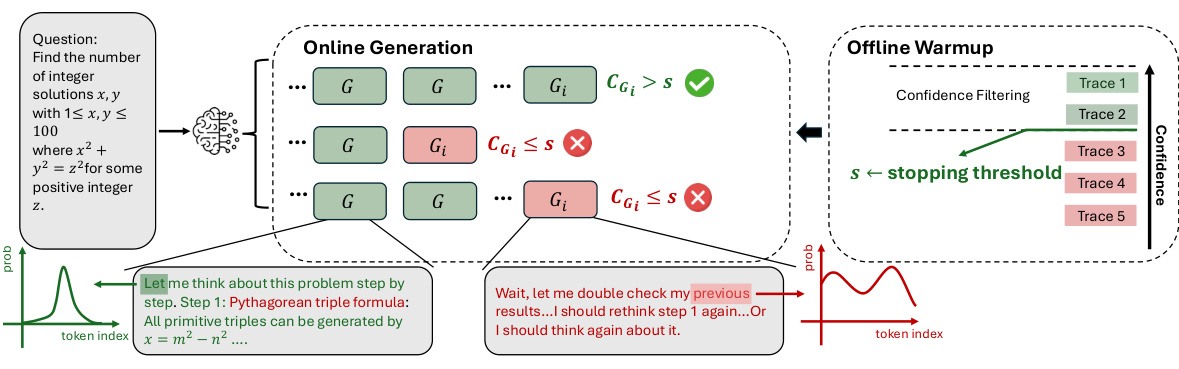

3. 在线实时优化

更厉害的是实时生成过程中的动态优化:

-

预热阶段:先生成16个完整推理路径建立基线 -

动态终止:当某条路径的组置信度低于阈值时提前终止生成 -

自适应采样:根据已生成答案的共识度动态调整采样数量

图4:DeepConf 实时生成过程中的决策流程

四、实测效果:效率与准确率的平衡

1. 离线模式表现

在固定使用512条推理路径的情况下(表1):

| 模型 | 数据集 | 传统方法 | DeepConf(尾部置信度) |

|---|---|---|---|

| GPT-OSS-120B | AIME 2025 | 97.0% | 99.9% |

| DeepSeek-8B | HMMT 2025 | 69.6% | 83.9% |

| Qwen3-32B | AIME 2024 | 85.3% | 90.8% |

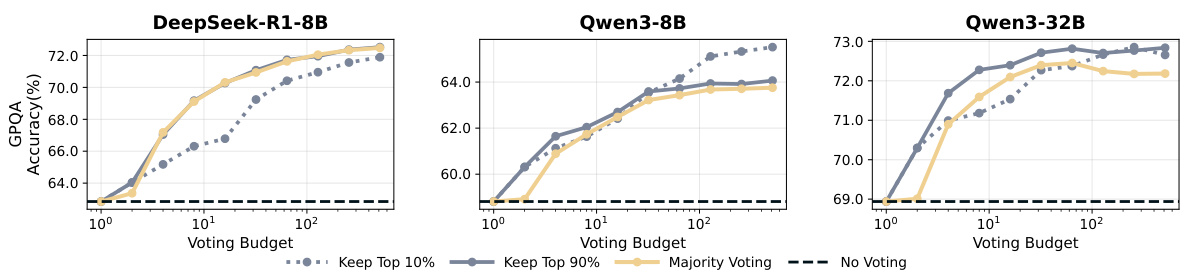

图3:不同置信度过滤策略的效果对比

2. 在线模式优势

在实时生成场景下(表2):

| 模型 | 数据集 | 传统方法 | DeepConf-low | 节省令牌 |

|---|---|---|---|---|

| GPT-OSS-120B | AIME 2025 | 3.23×10⁸ | 0.49×10⁸ | 84.7% |

| Qwen3-32B | AIME 2024 | 2.00×10⁸ | 0.66×10⁸ | 66.8% |

图7:不同方法在相同准确率下的计算资源消耗对比

五、实际应用建议

1. 部署建议

对于需要实时响应的场景(如在线教育平台):

# 伪代码示例:启用DeepConf的API调用

response = client.chat.completions.create(

model="gpt-oss-120b",

messages=[{"role": "user", "content": "解这个方程:x²+5x+6=0"}],

extra_body={

"enable_conf": True,

"window_size": 2048,

"threshold": 17

}

)

2. 参数调优建议

-

窗口大小:数学题建议2048 tokens,编程问题建议1024 tokens -

过滤阈值:保守策略选90%保留率,激进策略选10% -

共识阈值:建议设为0.95(达到95%共识时停止)

六、未来发展方向

-

训练阶段优化:将置信度机制融入强化学习过程 -

错误识别增强:解决模型过度自信导致的”自信错误” -

多模态扩展:将置信度机制应用于图文混合推理

七、常见问题解答(FAQ)

Q: DeepConf 需要修改模型架构吗?

A: 完全不需要,只需在推理阶段增加置信度计算模块。

Q: 窗口大小如何选择?

A: 建议根据问题类型设置:

-

数学证明:2048 tokens -

代码生成:1024 tokens -

常识推理:512 tokens

Q: 如何判断是否需要使用在线模式?

A: 当单次推理成本超过$0.01时,建议采用在线模式节省资源。

Q: 该方法对中文支持如何?

A: 置信度计算与语言无关,所有支持的语言模型均可使用。

图10:不同方法在GPQA钻石级测试集上的表现