SkillsBench 深度解析:为什么人工编写的 Agent 技能才能大幅提升 AI 效率?

核心问题:当前市场上成千上万的 AI Agent 技能究竟价值几何?如何判断一个技能是否真正有用,又该如何优化?

AI Agent 的能力边界正被一种名为“技能”的模块化知识包不断拓展。但一个尴尬的现实是:在数以万计的可用技能中,真正有效的凤毛麟角。最新研究 SkillsBench 通过 7308 条轨迹的严格测试揭示,人工精心编写的技能可将任务成功率提升最高达 51.9%,而模型自发生成的技能几乎毫无价值,甚至可能起反作用。这背后不仅是技术问题,更是对知识工程本质的重新思考。

一、当 AI 遇上“技能”:一个被寄予厚望的概念

什么是 Agent Skills?

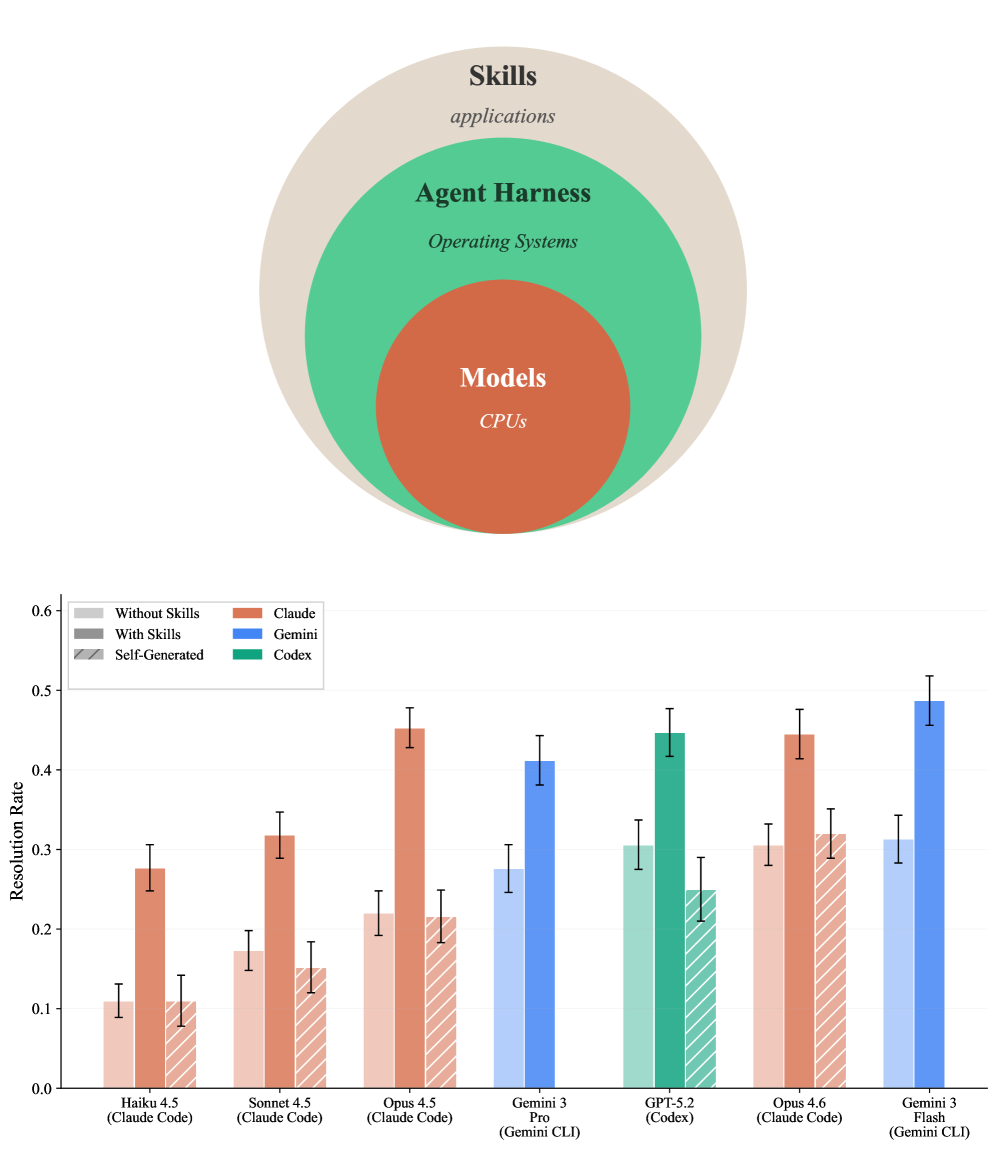

我们首先需要澄清一个关键概念:Agent Skills(智能体技能)并非简单的提示词或工具说明书。

一个合格的 Skill 是一个结构化的知识包,它必须同时满足四个条件:提供程序性指导(如何做而非是什么)、适用于一类任务而非单一实例、拥有结构化组件(如 SKILL.md 文件和可选资源)、具备跨模型与框架的可移植性。这使其从根本上区别于系统提示词、少样本示例、RAG 检索或工具文档。

可以把基础模型想象成 CPU,智能体框架是操作系统,而 Skills 则是安装在其上的应用程序——它为通用能力提供了特定领域的专业程序。

爆炸式增长与价值困境

技能生态系统经历了爆发式增长。来自开源社区、Claude Code 生态以及企业伙伴的技能包总数高达 47,150 个,涵盖了软件工程、数据分析乃至企业工作流。

然而,繁荣背后隐藏着深刻的信任危机。在 SkillsBench 的评估中,这些海量技能的有效性并未得到验证。更令人忧心的是,虽然软件工程领域的技能占据了 60%-80% 的份额,但在医疗、制造、金融等垂直领域,高质量技能严重匮乏。这种生态失衡意味着,当 AI 真正进入这些高价值专业场景时,可能面临“无技可施”的境地。

二、SkillsBench:如何科学地测试一个技能是否真的有用?

核心问题:如何构建一个能公平、准确评估“技能本身价值”的基准测试框架?

此前的 Agent 基准测试(如 SWE-bench、WebArena)主要评估模型或智能体在特定环境下的原生能力。它们回答的是“这个模型/智能体在任务 X 上表现如何”的问题。但 SkillsBench 首次将技能本身作为第一类评估对象,旨在回答一个更关键的问题:“技能 Y 对任务 X 的表现提升究竟有多大贡献?”

三层对照实验:为技能价值“验明正身”

SkillsBench 的核心方法论是配对对照实验。每个任务都会在三种严格区分的条件下进行测试:

-

无技能:智能体仅收到任务指令,环境中不提供任何技能包。这代表了智能体的原生基线能力。 -

精编技能:环境中包含由领域专家撰写、经过严格审核和去重的技能包。这是测试技能潜在价值的理想状态。 -

自生成技能:不提供外部技能,但要求智能体在开始任务前,先生成其认为有用的程序性知识,再进行任务。这旨在测试模型利用自身内隐知识生成技能的能力。

这种设计允许我们清晰地剥离出技能的独立贡献,而非混淆于模型能力或上下文长度等其他因素。

如何确保测试的公正与严谨?

为了使测试结果可信,SkillsBench 在数据集构建上制定了近乎严苛的原则,整个过程分为自动化验证与人工审核两阶段。

自动化验证“过滤网”:

-

结构完整性:必须包含指令、任务配置、解决方案脚本和验证脚本。 -

神谕执行:提供的参考解决方案必须能 100% 通过验证测试,确保任务本身是可解的。 -

指令质量:指令必须由人类撰写,且符合明确输出路径、结构化要求等六大标准。

人工审核“质量门”:

通过自动化验证的任务,会由领域专家进行五大维度评审:

-

数据真实性(杜绝玩具数据) -

任务现实性(反映真实专业工作流) -

解决方案专家性(与领域专家解题思路一致) -

技能质量(无错误、逻辑一致、对同类任务确有通用价值) -

防作弊设计(防止通过编辑输入数据、从测试文件提取答案等捷径解题)

更关键的是,所有任务都经过“泄露审计”,确保技能包中不包含任务特定的答案、文件名或魔法数字。技能必须提供“如何做”的方法论,而非“是什么”的答案。最终,从 322 个候选任务中精选出 84 个,跨越 11 个领域,并根据专家估计的人类解决时间分为核心、扩展、极限三个难度等级。

三、核心发现:四万技能,为何仅“千”金?

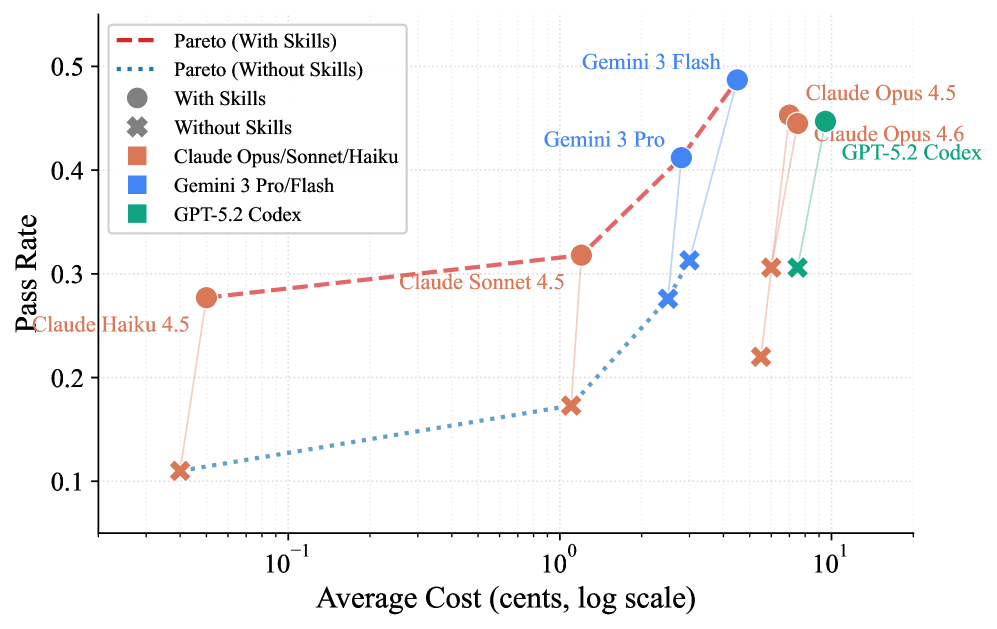

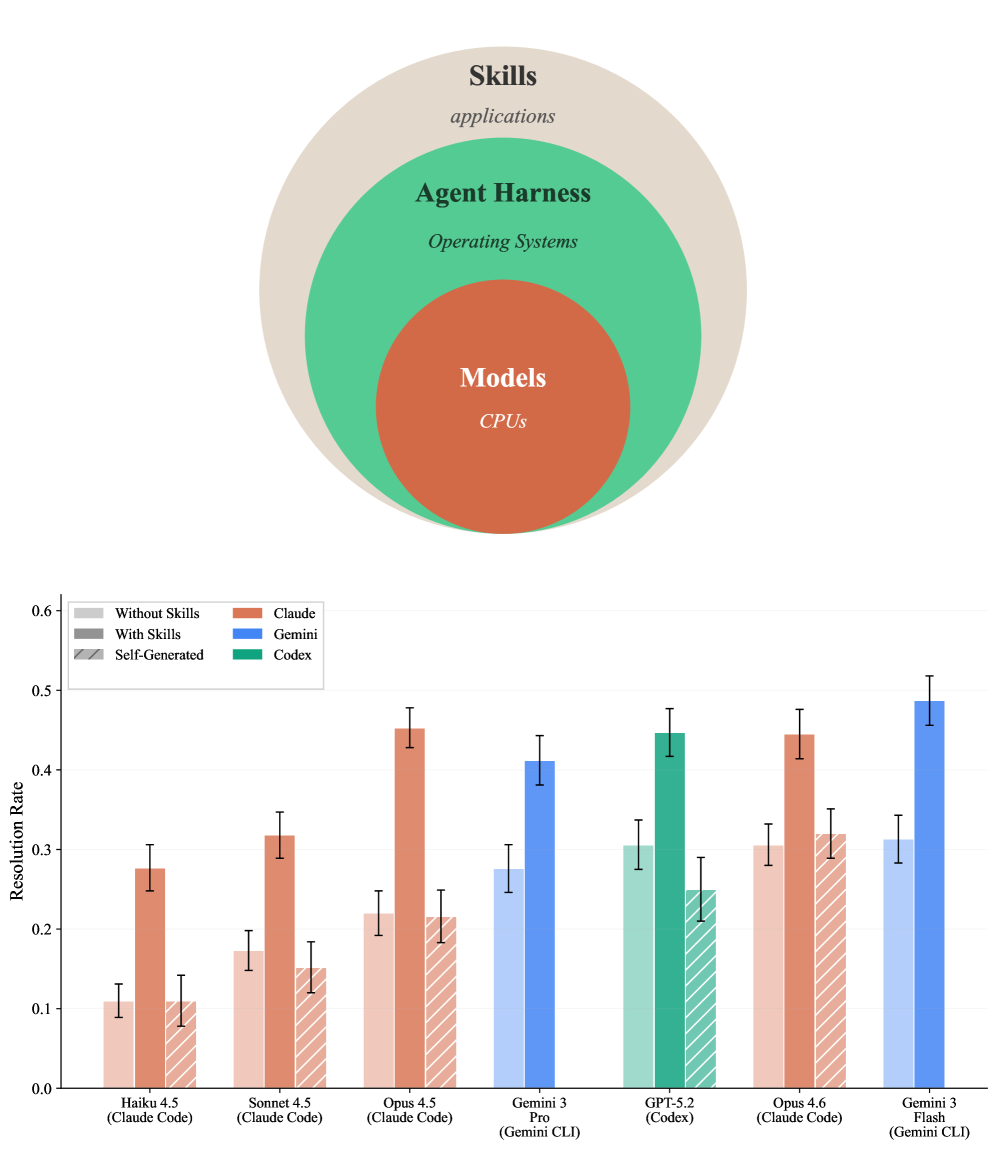

核心问题:在对 84 个任务、7 种模型配置的 7308 条轨迹测试后,技能的真实价值表现如何?

发现一:人工技能价值巨大,但收益方差极高

数据显示,经过精编的人工技能平均能将任务通过率提升 16.2 个百分点。这是一个积极的总体信号,证明专业知识的注入确实有效。

然而,平均值掩盖了巨大的差异性。这种效益因领域不同而天差地别:

-

在医疗领域,技能带来的提升高达 +51.9pp。 -

在制造业,提升同样显著,达到 +41.9pp。 -

相比之下,在软件工程和数学领域,提升仅为 +4.5pp 和 +6.0pp。

甚至有 16 个任务在引入技能后,表现反而下降。例如,在“分类学树合并”任务中,性能下降了 39.3 个百分点。这表明,技能并非万能药,如果引入的指导与模型已有的强先验知识冲突,或增加了不必要的认知负担,就会起到反效果。

发现二:AI 自生成的技能几乎一文不值,甚至有害

这是本项研究最“扎心”的结论。与人工技能形成鲜明对比的是,让模型自己生成技能不仅无法带来收益,反而可能导致性能轻微下降。

实验中,仅有 Claude Opus 4.6 在自生成技能条件下获得了微弱提升(+2.0%)。而 Codex + GPT-5.2 的组合因此性能暴跌 8.1%。轨迹分析揭示了两种失败模式:模型要么生成模糊、不完整的流程(如只说“使用 pandas”,却未说明具体 API 模式),要么对于医疗、制造等高专业领域,压根未能意识到需要专门技能,直接用通用方法硬解。

这一发现深刻地指出:模型擅长消费结构化知识,却不擅长生产高质量的结构化程序性知识。 真正有效的 SOP,是人类领域经验的结晶,难以被模型无中生有地创造。

发现三:技能效能严重依赖智能体框架的整合能力

“好的技能也需要好的平台”。研究发现,不同智能体框架对技能的利用能力大相径庭。

-

Claude Code 表现出最高的技能利用率,所有 Claude 模型均能稳定受益。 -

Gemini CLI 在集成技能后取得了最高的原始性能(48.7%)。 -

Codex CLI 则暴露了一个问题:即使提供了技能,智能体也经常在“承认”收到内容后,依然自行其是,独立实现解决方案。

这提醒我们,评估技能价值时不能脱离其所运行的智能体环境。框架层面的检索、上下文管理和指令遵循机制,是技能发挥作用的关键中间层。

四、技能设计手册:从实验结果反推的最佳实践

核心问题:既然技能有效,那么什么样的技能才更有效?应该如何编写?

基于大规模实验,我们可以提炼出技能设计的核心原则。这些不是理论推测,而是从 7308 次实际运行中得出的结论。

原则一:聚焦是王道,拒绝“大而全”

数量不是越多越好:当每个任务配备 4 个或更多技能时,平均收益暴跌至 +5.9pp,远低于配备 2-3 个技能时的 +18.6pp。

内容绝非越长越好:详细但聚焦的技能平均提升 +18.8pp。而所谓“全面”的长篇文档,非但没有增益,反而导致性能下降 -2.9pp。

这背后的逻辑很清晰:智能体和人一样,面对过载的信息会陷入认知困境。优秀的技能应该是手术刀般的精准工具,而非一本百科全书。它需要提供分步骤的、可操作的指导,并附带至少一个可运行的工作示例,这比冗长的理论文档有效得多。

原则二:模块化设计,适配框架约束

单一的、庞大的技能难以应对复杂任务。研究表明,模块化的技能在处理多部分任务时,组合效果更好。每个技能应该解决一个清晰的问题或步骤。

同时,技能的编写必须考虑到智能体框架的具体约束。例如,如果框架要求严格的 JSON 输出协议,那么技能中就应该反复提醒格式要求,防止智能体在长交互链中发生“格式漂移”。

原则三:瞄准“高价值”空白领域

投资回报率最高的技能领域,是那些模型预训练数据覆盖不足,但又有高度专业化流程的领域。

-

医疗:临床数据协调、诊断流程编码。 -

制造:生产工作流优化、设备协议对接。 -

网络安全:渗透测试标准流程。 -

金融:特定监管报告生成。

在这些领域,一个优秀的技能可能相当于一位资深专家的数年经验沉淀,能够为通用模型带来质的飞跃。相反,在软件工程、数学等模型已通过海量代码训练“熟透”的领域,技能带来的边际收益较低。

原则四:小模型+好技能,可挑战大模型

这可能是最具商业价值的发现之一。在 Claude 模型家族的对比中,小模型 Claude Haiku 4.5 在获得优质技能后,性能达到了 27.7%。而大模型 Claude Opus 4.5 在无技能辅助下,性能仅为 22.0%。

小模型 + 精心设计的技能 ≈ 甚至 > 大模型的原生能力

这意味着,对于成本敏感、有明确垂直领域需求的场景,构建高质量的技能库比单纯追逐模型参数规模更为经济有效。它为企业定制化 AI 应用提供了一条切实可行的降本增效路径。

五、实践启示:如何启动你的技能工程项目

核心问题:对于企业和开发者,如何将研究发现转化为实际行动?

行动一:建立人工主导的技能开发流程

明确一点:让 AI 自动生成技能目前是行不通的。你需要的是一套以领域专家为核心的知识工程流程。

-

挖掘 SOP:访谈你的资深员工、专家,将他们解决某一类问题的标准操作流程梳理出来。这是技能的原始素材。 -

结构化封装:将 SOP 转化为 SKILL.md格式,明确步骤、注意事项、常见错误。为核心步骤编写可复用的代码模板或脚本。 -

提供工作示例:为一个具体的典型任务,展示完整的应用技能的解决过程。这是最有效的教学方式。 -

持续迭代:在真实使用中,收集智能体的失败案例,反向优化技能文档,填补模糊地带。

行动二:优先填补垂直领域的技能空白

审视你的业务领域。如果它属于医疗、法律、制造、能源等专业领域,那么现在构建技能库的时机极佳。因为:

-

竞争对手可能尚未行动。 -

模型在该领域的原生能力最薄弱,技能带来的提升最显著。 -

你的专业知识有很高的护城河价值。

行动三:选择或构建擅长利用技能的智能体框架

在选型或开发智能体平台时,不应只看模型接入的广度,更要考察其对上下文管理和技能调用的深度。

-

框架是否能在长期记忆和当前任务之间,有效加载和聚焦相关技能? -

是否能避免长对话中的“指令遗忘”问题? -

是否支持技能的模块化组合与动态加载?

选择一个对技能整合友好的框架,是让你的知识投资得以回报的技术基础。

六、实用摘要与一页速览

实用摘要 / 操作清单

-

勿信 AI 自生成技能:当前模型无法可靠创造高质量技能,必须依靠人类专家知识。 -

追求聚焦,避免全面:编写 2-3 个针对性强、步骤清晰的技能,远胜于一份长篇大论的“全面”文档。 -

瞄准高价值领域:在医疗、制造、法律等垂直领域投入技能开发,投资回报率最高。 -

小模型大有可为:用高质量技能赋能小模型,可在特定任务上以更低成本达到或超越大模型效果。 -

重视框架选型:选择能有效检索、理解和应用技能上下文的智能体框架。 -

标准化开发流程:建立“专家访谈 → SOP 梳理 → 结构化封装 → 示例提供 → 迭代优化”的人工主导流程。

一页速览

核心结论:经 SkillsBench 严格测试,人工精编技能平均提升 AI 任务成功率 16.2%,最高达 51.9%;而模型自生成技能几乎无效甚至有害。

关键数据:

-

有效技能比例:在约 4.7 万个技能生态中,经严格筛选用于高质量评测的约 1000 个。 -

最佳数量:每个任务配备 2-3 个技能效果最佳,超过 4 个收益锐减。 -

最佳形式:详细但聚焦的指导 + 至少一个工作示例 > 冗长的全面文档。 -

高价值领域:医疗 (+51.9pp)、制造 (+41.9pp)、网络安全 (+23.2pp)。

行动建议:建立人工主导的技能开发流程,优先在垂直专业领域构建技能库,并选择对技能整合友好的智能体框架,以实现 AI 能力的专业化与成本优化。

七、常见问题解答 (FAQ)

Q1:我的业务场景相对独特,有没有现成的技能可以直接用?

A:目前公开的高质量技能主要集中于软件工程和数据科学。对于医疗、制造、法律等垂直领域,现成资源稀缺。最佳方案是启动内部专家主导的技能开发项目,将您的独特业务流程转化为 AI 可用的知识资产。

Q2:技能和 RAG(检索增强生成)有什么区别?我应该用哪个?

A:RAG 主要用于补充事实性知识(“是什么”),而技能用于补充程序性知识(“怎么做”)。如果您的任务是回答“公司的休假政策是什么”,用 RAG;如果任务是“请按内部合规流程填写一份项目风险评估报告”,则需要技能。两者可以结合使用。

Q3:评估技能是否有效,有没有一个简单的测试方法?

A:可以采用简单的对照测试。选择一类您已有清晰 SOP 的任务,让智能体分别在“无技能”和“安装技能”两种情况下各执行数次。比较成功率、完成时间和输出质量的一致性。如果提升明显,则证明技能有效。

Q4:技能会让模型变“笨”吗?为什么有任务加技能后性能反而下降?

A:会。如果技能内容与模型已有的高质量先验知识冲突,或者技能过于冗长、模糊,都会导致智能体困惑和决策失误。这反过来说明了技能质量的重要性——错误或低效的指导比没有指导更糟糕。

Q5:对于非技术人员,如何理解“技能”的价值?

A:可以把它理解为给 AI 办事员的“工作手册”或“专家辅导”。没有手册,它可能用通用方式摸索,效率低且易出错;有了精准手册,它就能像熟手一样高效、规范地完成专业工作。而手册必须由真正的专家来写。

Q6:未来 AI 能自动生成技能吗?本项研究对未来有何启示?

A:本研究表明,在可预见的未来,高质量技能仍需依赖人类专家。这并不意味着 AI 无用,而是 AI 的角色将从“内容生成者”转变为“知识工程师的助手”,辅助人类进行 SOP 的记录、结构化和优化,最终决策权仍在人手中。这启示我们,构建人机协作的知识工程体系,是下一个阶段的重点。

图片来源:研究论文附图、Unsplash(示意图)